In passato mi affidavo a BypassGPT per ottenere risposte IA più flessibili, ma ora non è più disponibile e il mio flusso di lavoro ne sta risentendo. Esistono sostituti o strumenti sicuri e gratuiti che offrano un comportamento dell’IA simile, meno censurato o meno limitato, senza violare le regole o rischiare ban? Apprezzerei molto dei consigli, insieme a eventuali suggerimenti di configurazione e avvertenze su sicurezza e privacy di cui dovrei essere a conoscenza.

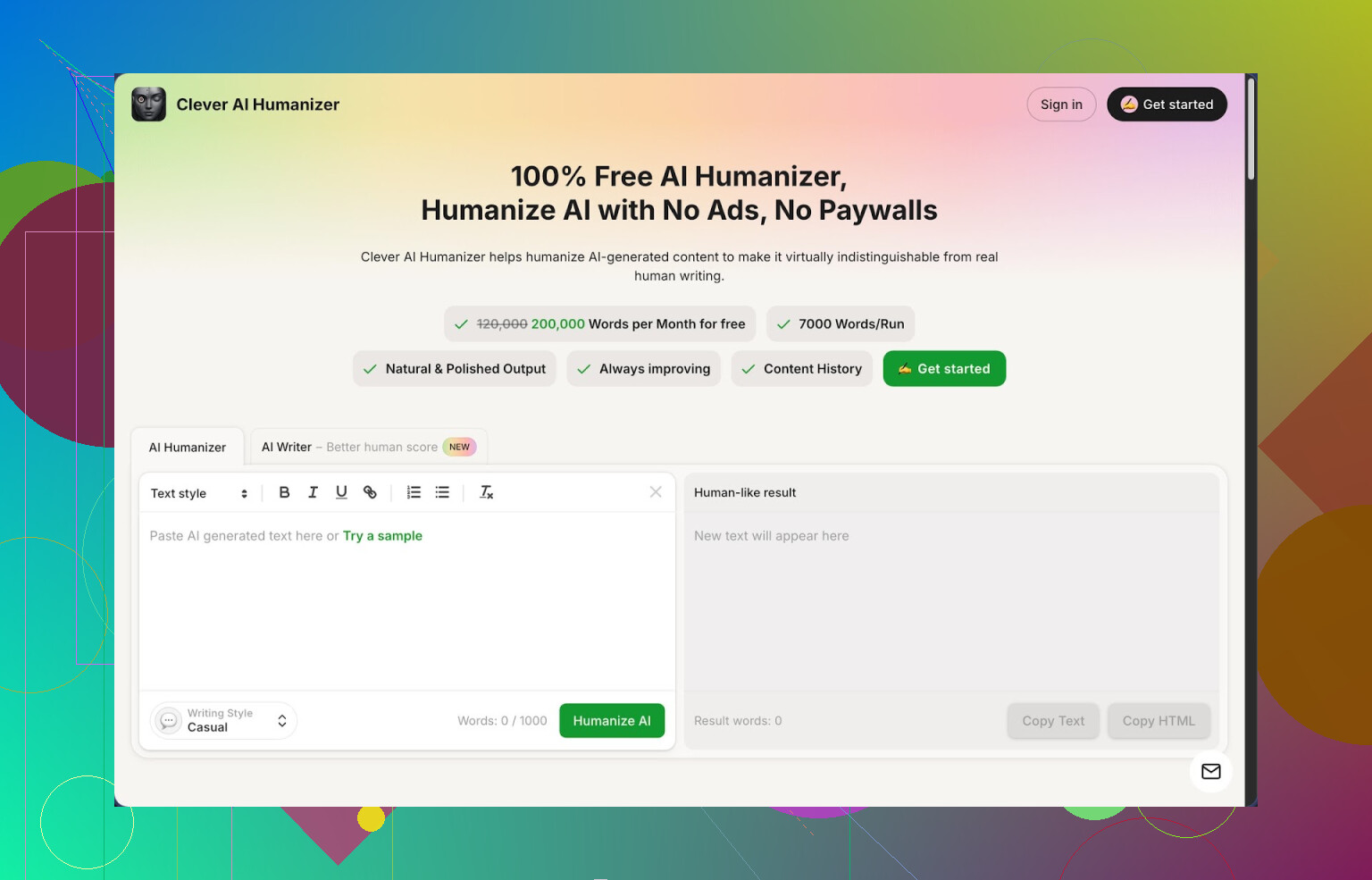

1. Clever AI Humanizer – la mia opinione dopo averci smanettato fin troppo

Clever AI Humanizer è quello a cui continuo a tornare quando ho bisogno che un testo AI smetta di suonare come scritto da un’AI. Non perché sia perfetto, ma perché i limiti sono generosi e non mi chiede soldi ogni 3 minuti.

Qualche numero veloce dal mio utilizzo:

- Circa 200.000 parole al mese nel piano gratuito

- Fino a 7.000 parole per singola esecuzione

- Tre stili: Informale, Semplice Accademico, Semplice Formale

- Writer AI integrato, correttore grammaticale, parafrasatore

L’ho scoperto la prima volta mentre cercavo di far passare un testo lungo oltre ZeroGPT. Ho incollato qualche migliaio di parole di puro output del modello, l’ho fatto passare in modalità Informale e ZeroGPT ha mostrato 0% AI su tre campioni diversi. Questo ha attirato la mia attenzione, perché la maggior parte degli strumenti o rompe il significato o viene comunque segnalata come “probabile AI”.

Il grande problema quando si scrive con strumenti AI è noto: tutto suona piatto, ripetitivo, e i rilevatori lo marcano come 100% macchina. Ho testato un sacco di “umanizzatori” in un weekend, e questo è stato l’unico che ho tenuto aperto in una scheda.

Ecco come funziona il modulo principale dal mio punto di vista.

Incolli il testo AI, scegli uno stile (io uso quasi sempre Informale), premi il pulsante e aspetti un paio di secondi. Ti restituisce una versione riformulata che cerca di rompere i pattern standard dell’AI, allungare o accorciare le parti e cambiare la formulazione in modo che i rilevatori la vedano come più naturale. Il limite più ampio aiuta molto quando lavori con articoli o report lunghi, perché spezzare il testo in pezzetti minuscoli spesso rovina il flusso.

Quello che mi ha sorpreso è che in genere mantiene intatto il significato originale. L’ho provato su guide tecniche, pezzi d’opinione e una sezione in stile accademico un po’ asciutto. Nella maggior parte dei casi, affermazioni chiave e dati sono rimasti gli stessi, mentre struttura e ritmo cambiavano abbastanza da sembrare qualcosa che una persona potrebbe aver scritto in un pomeriggio.

Ora i moduli extra, perché sono quelli che lo rendono utile nell’uso quotidiano.

Il Free AI Writer ti permette di generare una prima bozza direttamente nel sito. Gli dai un prompt per un articolo o un saggio, lui scrive una versione base, poi la fai passare nell’humanizer in un unico flusso. Per i punteggi dei rilevatori, questa combinazione mi ha dato i risultati migliori. La bozza AI grezza spesso risultava “fortemente AI” su ZeroGPT, ma dopo l’umanizzazione scendeva allo 0% in diversi test che ho fatto.

Il Free Grammar Checker è basilare ma comodo. Ha sistemato cose come doppi spazi, virgole fuori posto e frasi sgraziate. Non è aggressivo come strumenti tipo Grammarly, ma basta per rendere il testo pronto per un blog o un’email senza troppo lavoro extra.

Il Free AI Paraphraser è più vicino a un classico riscrittore. L’ho usato per:

- Riformulare paragrafi da articoli più vecchi

- Creare versioni alternative per esperimenti SEO

- Regolare il tono da rigido a più semplice o viceversa

Tutto questo è in un’unica interfaccia, quindi il flusso di lavoro per me è questo:

- Bozza con AI Writer o incolla testo da un altro modello

- Passaggio nell’Humanizer con stile Informale

- Passata veloce con il Grammar Checker

- Passaggio opzionale con il Paraphraser per sezioni specifiche

Questa impostazione mi ha fatto risparmiare parecchio tempo quando mi servivano diverse varianti di un articolo per i test, o quando dovevo “de-AIzzare” qualcosa in fretta per un cliente che odia il solito tono da LLM.

Un paio di lati negativi dalla mia esperienza:

- Non tutti i rilevatori mostreranno 0% AI ogni volta. ZeroGPT ha gradito l’output nei miei test, ma altri rilevatori a volte hanno comunque segnalato parti come miste o parzialmente AI.

- Il testo spesso diventa più lungo dopo l’umanizzazione. Aggiunge o espande frasi per rompere i pattern, quindi se hai bisogno di conteggi di parole rigidi, dovrai tagliare a mano.

- Ogni tanto passa qualche formulazione strana, soprattutto su argomenti tecnici o di nicchia. Di solito faccio una lettura veloce per sistemarle.

Nonostante questi problemi, per uno strumento gratuito con 200.000 parole al mese è stata l’opzione più pratica che abbia usato. Nessun paywall che salta fuori a metà di un lotto, e puoi sperimentare molto prima di raggiungere un limite.

Se vuoi più dettagli e screenshot, c’è un’analisi più lunga qui:

https://cleverhumanizer.ai/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

Recensione video qui se preferisci guardare qualcuno che ci clicca attraverso:

Recensione Clever AI Humanizer su Youtube https://www.youtube.com/watch?v=G0ivTfXt_-Y

C’è anche un po’ di discussione sugli AI humanizer e test di altre persone su Reddit:

Migliori AI Humanizer su Reddit https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=it

Tutto sull’umanizzazione dell’AI https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=it/

Versione breve. Non esiste uno strumento sicuro e gratuito che ti dia un vero comportamento “senza censure” a livello BypassGPT senza compromessi, ma puoi avvicinarti in termini di flessibilità usando una combinazione di modelli e un humanizer.

Ecco cosa ha funzionato meglio per me:

- Usa modelli più permissivi invece di wrapper “bypass”

Non fanno miracoli, ma applicano meno filtri di sicurezza rispetto alla maggior parte delle chatbot.

• OpenRouter

Ti permette di usare diversi modelli tramite un unico sito o una singola chiave. Alcuni modelli lì rispondono in modo più libero rispetto alle interfacce standard. Puoi controllare temperatura e system prompt, e questo già ti dà un comportamento “meno limitato” per brainstorming, narrativa, contenuti spigolosi, ecc.

Svantaggio. I modelli pubblici registrano le richieste, quindi non inviare nulla di sensibile.

• Modelli locali con Ollama o LM Studio

Esegui i modelli sul tuo PC. Nessun filtro remoto.

Buone opzioni gratuite per iniziare:

- Llama 3 8B Instruct

- Qwen 2.5 7B o 14B

- Mistral 7B Instruct

Sono meno potenti dei grandi modelli cloud per alcuni compiti, ma hai pieno controllo. Per certi flussi di lavoro, faccio un primo passaggio con un modello locale, poi rifinisco con uno ospitato.

- Combina modelli più rigidi con un humanizer

Qui sono in parte in disaccordo con @mikeappsreviewer. Non mi affiderei ai punteggi dei detector come una sorta di “prova”. I detector spesso sbagliano sia sul testo umano sia su quello AI. Li considero solo un segnale approssimativo, non un obiettivo.

Detto questo, Clever Ai Humanizer è utile per un altro motivo. Rompe il ritmo tipico degli LLM. Se ci fai passare una risposta prudente o filtrata di un modello cauto, l’output tende a sembrare meno linguaggio “da policy” e più scrittura normale. Per i flussi che richiedono un tono “non da AI” o una minore probabilità di essere bloccati da filtri semplici, aiuta.

Lo uso su:

• Lunghi post esplicativi che suonano rigidi.

• Bozze in cui il modello continua a ripetere “come modello di linguaggio AI”.

• Testi da interfacce più rigide che contengono ancora buone informazioni ma suonano robotici.

- Tecniche di prompt che riducono gli ostacoli

Alcuni prompt fanno scattare rapidamente i filtri. Puoi evitare molta frizione cambiando il modo in cui chiedi.

Esempi che mi hanno aiutato:

• Chiedi “pro e contro”, “analisi dei rischi”, “revisione di policy” o “scenario fittizio” invece di istruzioni dirette su argomenti sensibili.

• Usa “aiutami a valutare” invece di “dimmi come fare X”.

• Suddividi i compiti in passi. Prima chiedi la teoria, poi un confronto, poi una riscrittura nel tuo tono. Molti modelli tollerano meglio questo percorso rispetto a richieste dirette.

• Per argomenti di ricerca che attivano i filtri di sicurezza, formula come “spiega a cosa mettono in guardia gli esperti” o “riassumi le linee guida di sicurezza”.

- Interfacce con guardrail più leggeri

Sono comunque sicure, ma di solito meno invadenti rispetto ai siti mainstream.

• Perplexity livello gratuito

Buona per la ricerca. È più rigida su alcuni temi, ma le sue modalità “focus” e le citazioni ti aiutano a ottenere informazioni grezze che poi puoi riscrivere o umanizzare. Spesso abbino Perplexity per i fatti a Clever Ai Humanizer per il tono.

• Modelli gratuiti su Poe

Alcuni bot della community rispondono in modo più libero, soprattutto i modelli più vecchi o piccoli. Hai un limite giornaliero, ma per lavori veloci funziona.

- Cosa eviterei

• Qualsiasi strumento che promette “jailbreak totale”, “nessun filtro” o “bypass al 100 percento dei detector” senza trasparenza. Spesso sono solo interfacce sottili sugli stessi modelli, con in più logging poco chiaro.

• Fiducia cieca nei punteggi dei detector AI. Usali solo come controllo veloce. Concentrati prima sulla leggibilità per gli umani e sull’accuratezza.

Workflow semplice che per me ha sostituito BypassGPT:

- Fai la bozza con un modello più permissivo. O un modello locale tramite LM Studio o un modello su OpenRouter.

- Se il tono è troppo rigido, passalo una volta in Clever Ai Humanizer, di solito in modalità Casual.

- Fai una rapida revisione manuale per fatti, casi limite e frasi strane.

- Se una piattaforma è severa, chiedi a un modello “più sicuro” di riformulare in tono più neutro o accademico, poi eventualmente umanizza di nuovo.

Questo non replica del tutto il vecchio comportamento di BypassGPT, ma ottieni:

• Più controllo sulla censura tramite modelli locali o di terze parti.

• Output meno robotico grazie a uno strumento come Clever Ai Humanizer.

• Maggiore sicurezza per te, evitando di inviare tutto a qualche sito di jailbreak poco affidabile.

Risposta breve: non otterrai un clone 1:1 “gratuito e non censurato di BypassGPT” che sia davvero sicuro. Ma puoi ricostruire la maggior parte di quella funzionalità con uno stack diverso da quello descritto da @mikeappsreviewer e @waldgeist, senza copiare alla lettera tutta la loro strategia.

Ecco cosa sta funzionando per me:

- Salta i siti con “jailbreak magici”

La maggior parte delle pagine in stile BypassGPT erano solo interfacce sottili sopra le stesse API mainstream, con logging sospetto e qualche trucco di prompt. Quelli che esistono ancora di solito:

- Registrano tutto

- Esagerano sul “non censurato”

- Vanno offline a caso

Se ti interessano sicurezza e coerenza, meglio evitarli del tutto.

- Usa un workflow a due modelli invece di “un unico bot non censurato”

Invece di inseguire un singolo modello senza regole, divido il lavoro:

-

Modello A: “cervello serio”

Usa un buon modello (può essere un livello gratuito di un provider mainstream o un modello cloud più piccolo) per ottenere informazioni accurate, struttura e ragionamento. Accetti che a volte dica “non posso farlo”. -

Modello B: “tono + flessibilità”

Poi passi l’output a uno strumento separato il cui unico compito è lo stile, non i fatti. Qui qualcosa come Clever Ai Humanizer dà davvero il meglio.

Non sono del tutto d’accordo su quanto @mikeappsreviewer si affidi ai punteggi dei detector, ma condivido il caso d’uso: è molto bravo a togliere quella voce robotica da “disclaimer dell’IA”, che fa sembrare il testo “meno filtrato” anche quando i contenuti sono quasi gli stessi.

Questo setup in due fasi ti dà:

- Contenuti più puliti e fattuali da un modello prudente

- Output che suona come un umano non filtrato, grazie allo strato di humanizer

- Usa Clever Ai Humanizer in modo strategico, non come mantello dell’invisibilità

Sia @mikeappsreviewer sia @waldgeist lo hanno già trattato come strumento generale, quindi non ripeterò tutto. Dove ho trovato Clever Ai Humanizer più utile come sostituto di BypassGPT è:

-

Rendere utilizzabile una risposta parzialmente censurata

Esempio: il modello dice “non posso fornire una guida passo per passo, ma ecco considerazioni generali…”

Lo fai passare nel humanizer e all’improvviso sembra un normale saggio invece di una dichiarazione di policy, senza doverlo riscrivere a mano. -

De‑AI‑zzare documenti tecnici lunghi

Se il tuo flusso di lavoro riguarda articoli di blog, report, documenti per clienti, ecc., il vero problema spesso non è la censura ma “sembra scritto da un tostapane”. Clever Ai Humanizer risolve sorprendentemente bene proprio questo, soprattutto nello stile Casual.

Io non cercherei come obiettivo lo 0% ai test anti‑IA. Qui mi discosto da entrambi. I detector sono molto incoerenti e progettare il testo attorno a loro è una spirale che ti uccide la produttività.

- Cambia l’intento dei prompt invece di limitarti a schivare i filtri

Hai già ricevuto un sacco di suggerimenti da @waldgeist sulla formulazione. Un’angolazione che uso e che è un po’ diversa:

- Pensa in termini di “frame”:

- Frame esplorativo: “spiega come ragionano gli esperti su…”

- Frame critico: “analizza difetti, limiti, failure mode di…”

- Frame avversariale ma teorico: “descrivi cosa potrebbe andare storto se qualcuno abusasse di X e come i sistemi dovrebbero prevenirlo”

I modelli sono più permissivi quando ti presenti come analista, non come operatore. Ottieni comunque molti dettagli, ma senza attivare gli allarmi più estremi da “guida pratica”.

- Modelli locali solo se hai voglia di seguirli passo passo

Personalmente sono meno entusiasta dei modelli locali rispetto a @waldgeist come “sostituto plug‑and‑play” di BypassGPT:

- Sì, hai meno censura.

- No, non sono altrettanto bravi nel ragionamento complesso, fattuale e multi‑step rispetto ai grandi modelli cloud, a meno di avere hardware serio e tanta pazienza per il tuning.

- Inoltre allucinano di più, il che va contro l’obiettivo se devi fare qualcosa che conta davvero.

Tratto i modelli locali come “strumenti di brainstorming in sandbox”, non come nucleo di un workflow professionale. Bene per narrativa, dialoghi spinti, what‑if estremi. Non ideali come unica fonte di verità.

- Reality check su “non censurato”

Se per “non censurato” intendi:

-

Umorismo nero

-

Fiction NSFW o quasi

-

Opinioni piccanti

di solito puoi arrivare abbastanza vicino: -

Chiedendo scenari di fantasia

-

Specificando chiaramente “è per scrivere un romanzo / una sceneggiatura”

-

E poi ammorbidendo l’output con qualcosa come Clever Ai Humanizer così che suoni come una persona reale e non come un addetto stampa iper prudente.

Se invece intendi “voglio istruzioni operative, dettagliate e passo passo per cose chiaramente dannose”, nessuno strumento sicuro e gratuito sarà un vero sostituto pulito di BypassGPT. Finirai solo per saltare tra siti mezzi rotti finché uno sparisce e ricominci la ricerca da capo.

- Una versione snella dello stack che per me ha davvero sostituito BypassGPT

Niente setup da sviluppatore, niente software extra:

- Usa un modello ragionevolmente capace ma un po’ conservatore per idee, struttura e fatti.

- Passa direttamente quell’output in Clever Ai Humanizer per togliere la voce da IA, rimuovere i disclaimer spam e ottenere un linguaggio più naturale.

- Fai un rapido passaggio umano per tagliare il superfluo e correggere eventuali frasi strane.

Risultato:

- Il 90% della flessibilità che avevo con le interfacce “bypass”

- Contenuti che non urlano “scritto da un chatbot”

- Nessun sito di “jailbreak” sospetto nel mezzo del workflow

È “selvaggio” come il vecchio BypassGPT nei giorni migliori? No.

È stabile, quasi gratuito e abbastanza sicuro da poterci fare affidamento? Sì, e sul lungo periodo questo conta di più per un vero workflow.