Je comptais auparavant sur BypassGPT pour obtenir des réponses d’IA plus flexibles, mais il n’est plus disponible et cela perturbe mon flux de travail. Existe-t-il des substituts ou outils sûrs et gratuits offrant un comportement d’IA similaire, moins censuré ou moins restreint, sans enfreindre les règles ni risquer de bannissement ? J’apprécierais vraiment des recommandations, ainsi que des conseils de configuration ou des mises en garde concernant la sécurité et la confidentialité que je devrais connaître.

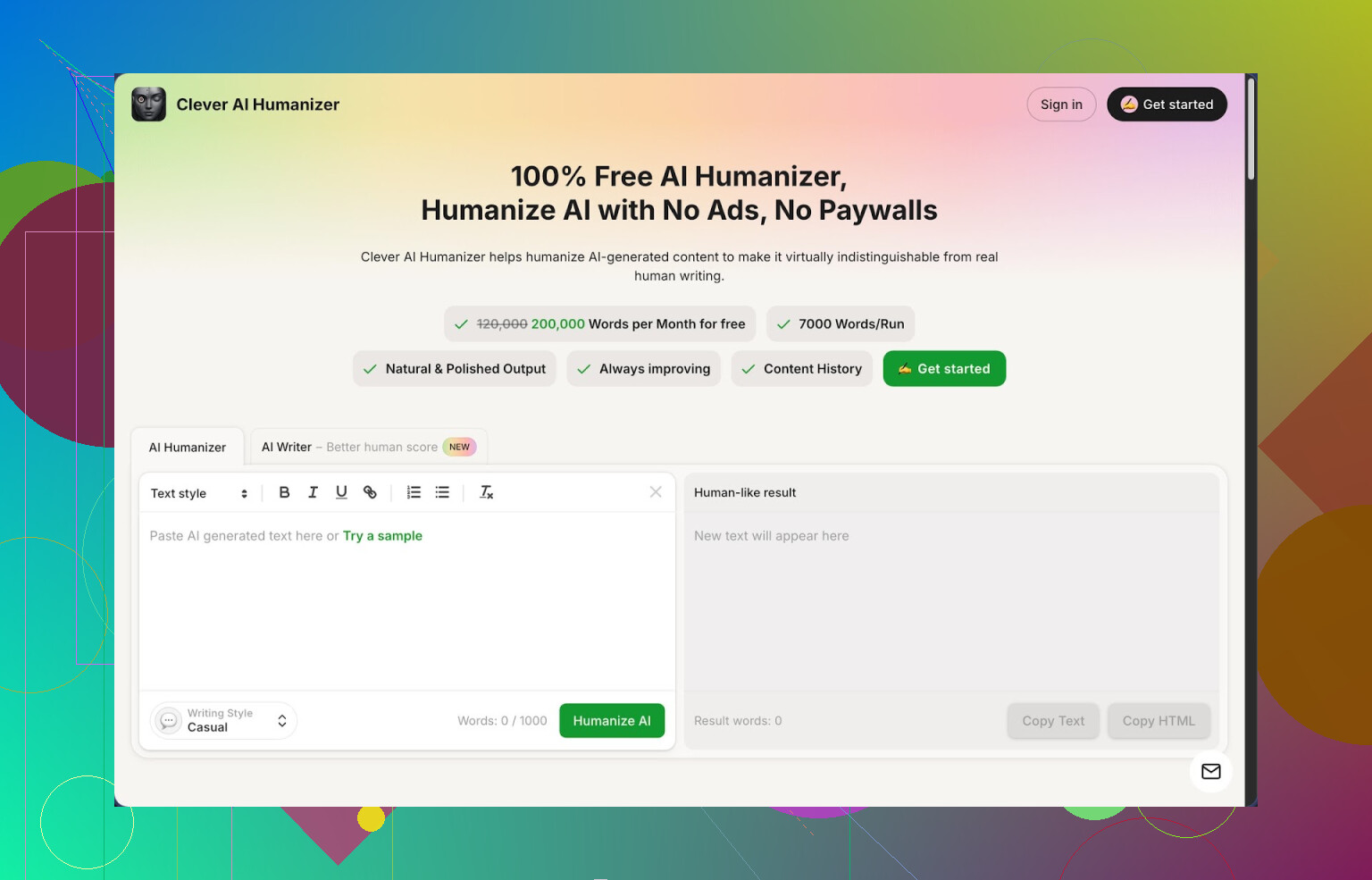

1. Clever AI Humanizer – mon avis après l’avoir testé beaucoup trop longtemps

Clever AI Humanizer est celui vers lequel je reviens toujours quand j’ai besoin que du texte généré par IA arrête de sonner comme de l’IA. Pas parce qu’il est parfait, mais parce que les limites sont généreuses et qu’il ne me harcèle pas pour de l’argent toutes les 3 minutes.

Quelques chiffres tirés de mon usage :

- Environ 200 000 mots par mois sur l’offre gratuite

- Jusqu’à 7 000 mots par traitement

- Trois styles : Décontracté, Simple académique, Simple formel

- Rédacteur IA intégré, correcteur grammatical, paraphraseur

Je l’ai découvert en essayant de faire passer un long texte devant ZeroGPT. J’ai collé quelques milliers de mots de pur texte de modèle, je l’ai passé en mode Décontracté, et ZeroGPT a affiché 0 % IA sur trois échantillons différents. Là, ça m’a interpellé, parce que la plupart des outils cassent le sens ou se font quand même marquer comme “probablement IA”.

Le gros problème quand on écrit avec des outils d’IA est connu : tout sonne plat, répétitif, et les détecteurs le marquent comme 100 % machine. J’ai testé une pelletée d’“humanizers” sur un week-end, et celui-ci a fini par être le seul que j’ai laissé ouvert dans un onglet.

Voici comment le module principal fonctionne de mon point de vue.

Vous collez votre texte d’IA, vous choisissez un style (je reste surtout sur Décontracté), vous cliquez sur le bouton et vous attendez quelques secondes. Il renvoie une version reformulée qui essaie de casser les schémas standards de l’IA, d’allonger ou raccourcir certains passages et de modifier le vocabulaire pour que les détecteurs le perçoivent comme plus naturel. La limite plus élevée aide beaucoup quand on travaille sur de longs articles ou rapports, puisque découper le texte en petits morceaux ruine souvent le flux.

Ce qui m’a surpris, c’est qu’il conserve généralement le sens original. Je l’ai essayé sur des guides techniques, des textes d’opinion et une section de type académique assez sèche. Dans la plupart des cas, les affirmations clés et les données restaient les mêmes, tandis que la structure et le rythme changeaient assez pour que ça ressemble davantage à quelque chose qu’une personne aurait tapé en une après-midi.

Passons maintenant aux modules supplémentaires, parce que c’est ça qui le rend vraiment utile au quotidien.

Le Free AI Writer permet de générer un premier brouillon directement sur le site. Vous lui donnez une consigne pour un article ou un essai, il écrit une version de base, puis vous faites passer ça dans l’humanizer dans un seul flux de travail. Pour les scores des détecteurs, cette combinaison m’a donné les meilleurs résultats. Le brouillon brut d’IA était souvent noté “fortement IA” sur ZeroGPT, mais après humanisation il tombait à 0 % sur plusieurs tests que j’ai faits.

Le Free Grammar Checker est basique mais pratique. Il corrige des choses comme les doubles espaces, les virgules perdues et les tournures maladroites. Moins agressif que des outils comme Grammarly, mais suffisant pour rendre un texte prêt pour un blog ou un e-mail sans trop de travail supplémentaire.

Le Free AI Paraphraser ressemble plus à un réécriveur standard. Je l’ai utilisé pour :

- Reformuler des paragraphes d’anciens articles

- Créer des versions alternatives pour des tests SEO

- Ajuster le ton, de rigide à plus simple, ou l’inverse

Tout ça se fait dans une seule interface, donc mon flux de travail ressemble à ça :

- Rédiger avec l’AI Writer ou coller du texte provenant d’un autre modèle

- Passer dans le Humanizer en style Décontracté

- Passage rapide avec le Grammar Checker

- Passage optionnel par le Paraphraser pour certaines sections

Cette configuration m’a fait gagner beaucoup de temps quand j’avais besoin de plusieurs variantes d’un article pour des tests, ou quand je devais “dés-IA-iser” quelque chose rapidement pour un client qui déteste le ton habituel des LLM.

Quelques inconvénients d’après mon usage :

- Tous les détecteurs ne vont pas afficher 0 % IA à chaque fois. ZeroGPT a apprécié la sortie dans mes tests, mais d’autres détecteurs ont parfois encore marqué certaines parties comme mixtes ou partiellement IA.

- Le texte devient souvent plus long après humanisation. Il ajoute ou développe des phrases pour casser les schémas, donc si vous avez des limites strictes de mots, il faudra couper à la main.

- Des tournures un peu étranges passent parfois, surtout sur des sujets techniques ou de niche. Je fais en général une relecture rapide pour ça.

Malgré ces points, pour un outil gratuit avec 200 000 mots par mois, c’est celui qui a été le plus pratique à utiliser pour moi. Aucun paywall qui surgit en plein traitement, et on peut expérimenter pas mal avant d’atteindre la limite.

Si vous voulez plus de détails et des captures d’écran, il y a une analyse plus longue ici :

https://cleverhumanizer.ai/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

Revue vidéo ici si vous préférez regarder quelqu’un cliquer dans l’interface :

Clever AI Humanizer Youtube Review https://www.youtube.com/watch?v=G0ivTfXt_-Y

Il y a aussi des discussions sur les humanizers d’IA et des tests d’autres personnes sur Reddit :

Meilleurs AI Humanizers sur Reddit https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=fr

Tout sur l’humanisation de l’IA https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=fr/

Version courte. Il n’existe pas d’outil gratuit, sûr, qui donne un vrai comportement “non censuré” au niveau BypassGPT sans compromis, mais on peut s’en approcher en souplesse avec un mélange de modèles et un humanizer.

Voici ce qui a le mieux fonctionné pour moi :

- Utiliser des modèles plus permissifs plutôt que des “wrappers de contournement”

Ce n’est pas magique, mais ils déclenchent moins de filtres de sécurité que la plupart des chatbots.

• OpenRouter

Permet d’accéder à plusieurs modèles avec un seul site ou une seule clé. Certains modèles y répondent plus librement que les interfaces classiques. Vous contrôlez la température et les prompts système, ce qui donne déjà un comportement “moins restreint” pour le brainstorming, la fiction, le contenu un peu limite, etc.

Inconvénient. Les modèles publics enregistrent les requêtes, donc ne rien envoyer de sensible.

• Modèles locaux avec Ollama ou LM Studio

Faites tourner les modèles sur votre propre PC. Aucun filtre à distance.

Bonnes options gratuites pour débuter :

- Llama 3 8B Instruct

- Qwen 2.5 7B ou 14B

- Mistral 7B Instruct

Ils sont moins puissants que les gros modèles cloud pour certaines tâches, mais vous gardez le contrôle total. Pour certains flux de travail, je fais un premier jet avec un modèle local, puis j’affine avec un modèle hébergé.

- Combiner des modèles plus stricts avec un humanizer

Là, je ne suis que partiellement d’accord avec @mikeappsreviewer. Je ne me fierais pas aux scores des détecteurs comme à une sorte de “preuve”. Les détecteurs se trompent souvent autant sur du texte humain que sur du texte IA. Je les traite comme un signal approximatif, pas comme un objectif.

Cela dit, Clever Ai Humanizer est utile pour une autre raison. Il casse le rythme typique des LLM. Si vous faites passer une réponse prudente ou filtrée d’un modèle très méfiant à travers lui, la sortie ressemble moins à du langage de politique de modération et plus à un texte normal. Pour les flux de travail qui ont besoin d’un ton “moins IA” ou d’une moindre probabilité d’être bloqués par des filtres basiques, ça aide.

Je l’utilise pour :

• De longs billets explicatifs qui sonnent raides.

• Des brouillons où le modèle répète sans cesse “en tant que modèle de langage IA”.

• Des textes issus d’interfaces strictes qui contiennent encore de bonnes infos mais lisent comme des robots.

- Tactiques de prompt pour réduire les blocages

Certains prompts déclenchent très vite les filtres. On évite beaucoup de frictions en changeant la manière de demander.

Exemples qui m’ont aidé :

• Demander une “analyse avantages‑inconvénients”, une “analyse des risques”, une “revue de politique” ou un “scénario fictionnel” plutôt qu’un mode d’emploi direct sur des sujets sensibles.

• Utiliser “aide‑moi à évaluer” au lieu de “dis‑moi comment faire X”.

• Découper les tâches en étapes. D’abord demander la théorie, puis une comparaison, puis une réécriture dans votre ton. Beaucoup de modèles tolèrent mieux ce chemin que des requêtes brutales.

• Pour les sujets de recherche qui déclenchent des garde‑fous, formuler les demandes comme “explique ce que les experts déconseillent” ou “résume les consignes de sécurité”.

- Interfaces avec garde‑fous plus légers

Elles restent sûres, mais généralement moins “moralisatrices” que les sites grand public.

• Perplexity version gratuite

Pratique pour la recherche. Il est plus strict sur certains sujets, mais ses modes “focus” et ses citations aident à extraire de l’info brute que vous réécrivez ou humanisez ensuite. J’utilise souvent Perplexity pour les faits et Clever Ai Humanizer pour le ton.

• Modèles gratuits sur Poe

Certains bots de la communauté répondent plus librement, surtout les modèles plus anciens ou plus petits. Il y a une limite quotidienne, mais pour des tâches rapides, ça fonctionne.

- Ce que j’éviterais

• Tout outil qui promet un “jailbreak total”, “aucun filtre du tout” ou “bypass à 100 % des détecteurs” sans transparence. Souvent, ce ne sont que des peaux fines sur les mêmes modèles, avec en plus une journalisation douteuse.

• Faire une confiance aveugle aux scores des détecteurs d’IA. Servez‑vous‑en comme d’un contrôle rapide uniquement. Priorisez d’abord la lisibilité humaine et la précision.

Workflow simple qui a remplacé BypassGPT pour moi :

- Rédiger un brouillon avec un modèle plus permissif. Soit un modèle local via LM Studio, soit un modèle sur OpenRouter.

- Si le ton est trop rigide, le passer une fois dans Clever Ai Humanizer, généralement en mode Casual.

- Faire une rapide relecture manuelle pour les faits, les cas limites et les tournures bizarres.

- Si la plateforme est stricte, demander à un modèle “plus sûr” de reformuler dans un ton plus neutre ou académique, puis éventuellement humaniser à nouveau.

Cela ne recrée pas totalement l’ancien comportement de BypassGPT, mais vous obtenez :

• Plus de contrôle sur la censure via des modèles locaux ou tiers.

• Un rendu moins robotique grâce à un outil comme Clever Ai Humanizer.

• Une meilleure sécurité pour vous‑même en évitant de tout envoyer à un site de jailbreak douteux.

Réponse courte : vous n’allez pas obtenir un clone gratuit et non censuré de BypassGPT au ratio 1:1 qui soit réellement sûr. Mais vous pouvez recréer la plupart de ses fonctionnalités avec une pile différente de celle décrite par @mikeappsreviewer et @waldgeist, sans copier tout leur mode opératoire.

Voici ce qui fonctionne pour moi :

- Ignorez les sites de “jailbreak magique”

La plupart des pages façon BypassGPT n’étaient que de fines couches au‑dessus des mêmes API grand public, avec des logs douteux et quelques astuces de prompt. Celles qui existent encore ont en général tendance à :

- Tout enregistrer

- Survendre le côté “non censuré”

- Tomber en panne aléatoirement

Si vous tenez à la sûreté et à la régularité, c’est rédhibitoire.

- Utilisez un flux à deux modèles plutôt qu’un “bot unique non censuré”

Au lieu de chercher un seul modèle “far west”, je découpe le travail :

-

Modèle A : “Cerveau sérieux”

Utilisez un bon modèle (par exemple un niveau gratuit d’un fournisseur grand public ou un modèle cloud plus petit) pour obtenir infos fiables, structure et raisonnement. Vous acceptez qu’il dise parfois “je ne peux pas faire ça”. -

Modèle B : “Ton + flexibilité”

Ensuite vous passez ça dans un outil séparé dont le seul travail est le style, pas les faits. C’est là que Clever Ai Humanizer est vraiment efficace.

Je suis un peu moins d’accord que @mikeappsreviewer sur l’importance des scores des détecteurs, mais je suis d’accord sur le cas d’usage : il est très bon pour enlever la voix robotique des “disclaimers IA”, ce qui donne l’impression de “moins de restrictions” même quand le fond est quasiment identique.

Ce montage en deux étapes vous donne :

- Un contenu plus propre et factuel grâce à un modèle prudent

- Un texte qui se lit comme un humain non filtré, via une couche de “humanizer”

- Utilisez Clever Ai Humanizer de façon stratégique, pas comme une cape d’invisibilité magique

@mi keappsreviewer et @waldgeist l’ont déjà couvert comme outil général, je ne vais pas répéter. Là où Clever Ai Humanizer m’a le plus servi comme remplaçant de BypassGPT, c’est pour :

-

Rendre utilisable une réponse partiellement censurée

Exemple : le modèle dit “Je ne peux pas fournir de guide étape par étape, mais voici des considérations générales…”

Vous passez ça dans le humanizer et ça devient un essai normal au lieu d’un énoncé de politique, sans tout réécrire à la main. -

“Dé-IA-tiser” de longs documents techniques

Si votre flux concerne articles de blog, rapports, documents clients, etc., le vrai problème n’est souvent pas la censure mais le côté “ça sonne comme écrit par un grille‑pain”. Clever Ai Humanizer corrige étonnamment bien ce point, surtout en style Décontracté.

Je ne viserais pas le 0 % aux détecteurs d’IA comme objectif. C’est là que je diverge d’eux. Les détecteurs sont très incohérents, et modeler votre texte pour eux est un puits sans fond qui ruine la productivité.

- Changez l’intention de vos prompts plutôt que de seulement esquiver les filtres

Vous avez déjà eu plein de conseils de formulation de @waldgeist. L’angle que j’utilise, légèrement différent :

- Pensez en termes de “cadres” :

- Cadre exploration : “décris comment les experts réfléchissent à…”

- Cadre critique : “analyse les faiblesses, limites, modes de défaillance de…”

- Cadre adversarial mais théorique : “décris ce qui pourrait mal tourner si quelqu’un détournait X, et comment les systèmes sont censés l’empêcher”

Les modèles sont plus souples quand vous vous présentez comme analyste, pas comme opérateur. Vous obtenez encore beaucoup de détails sans déclencher les alarmes extrêmes typées “mode d’emploi”.

- Modèles locaux uniquement si vous acceptez de les babysitter

Je suis personnellement moins enthousiaste que @waldgeist sur les modèles locaux comme “remplacement clé en main” de BypassGPT :

- Oui, il y a moins de censure.

- Non, ils ne sont pas aussi bons sur le raisonnement nuancé, factuel, en plusieurs étapes que les gros modèles cloud, sauf à avoir du gros hardware et du temps de réglage.

- Ils hallucinent aussi davantage, ce qui casse l’intérêt si vous faites quelque chose qui compte vraiment.

Je traite les modèles locaux comme des “boîtes à idées sandbox”, pas comme le cœur d’un flux pro. Très bien pour la fiction, les dialogues cash, les scénarios extrêmes. Pas génial comme seule source de vérité.

- Mise au point sur le “non censuré”

Si par “non censuré” vous entendez :

-

Humour noir

-

Fiction un peu NSFW

-

Opinions tranchées

vous pouvez généralement vous en approcher suffisamment en : -

Demandant des scénarios fictifs

-

Précisant clairement “c’est pour écrire un roman / scénario”

-

Puis en adoucissant la sortie avec un outil comme Clever Ai Humanizer pour que ça sonne comme une vraie personne et pas comme un attaché de presse frileux.

Si vous entendez “je veux des instructions opérationnelles détaillées et étape par étape pour des choses manifestement nuisibles”, aucun outil gratuit sûr ne fera un vrai remplaçant de BypassGPT. Vous passerez juste de sites bancals en sites bancals jusqu’à ce que l’un disparaisse et que vous recommenciez la chasse.

- Une version allégée de la pile qui a vraiment remplacé BypassGPT pour moi

Sans setup technique compliqué, sans logiciel en plus :

- Utilisez un modèle raisonnablement capable mais un peu conservateur pour les idées, la structure et les faits.

- Passez directement sa sortie dans Clever Ai Humanizer pour enlever la voix “IA”, supprimer les disclaimers spammy et obtenir un langage plus naturel.

- Faites un rapide passage humain pour enlever le bla‑bla et corriger d’éventuelles tournures bizarres.

Résultat :

- 90 % de la flexibilité que j’avais avec les frontends “bypass”

- Un contenu qui ne hurle pas “écrit par un chatbot”

- Aucun site de “jailbreak” douteux au milieu de mon flux

Est‑ce aussi débridé que l’ancien BypassGPT les bons jours ? Non.

Est‑ce assez stable, quasi gratuit et suffisamment sûr pour être fiable ? Oui, et pour un flux de travail de long terme, c’est ce qui compte le plus.